Es la llamada que ningún directivo quiere recibir un viernes por la tarde: «Tenemos una filtración de datos. Alguien ha subido la base de datos de clientes a una IA pública para ‘ordenarla’, y ahora esa información es pública.»

No es ciencia ficción. Es lo que en Evolupedia llamamos la crisis del «Shadow AI» (IA en la Sombra).

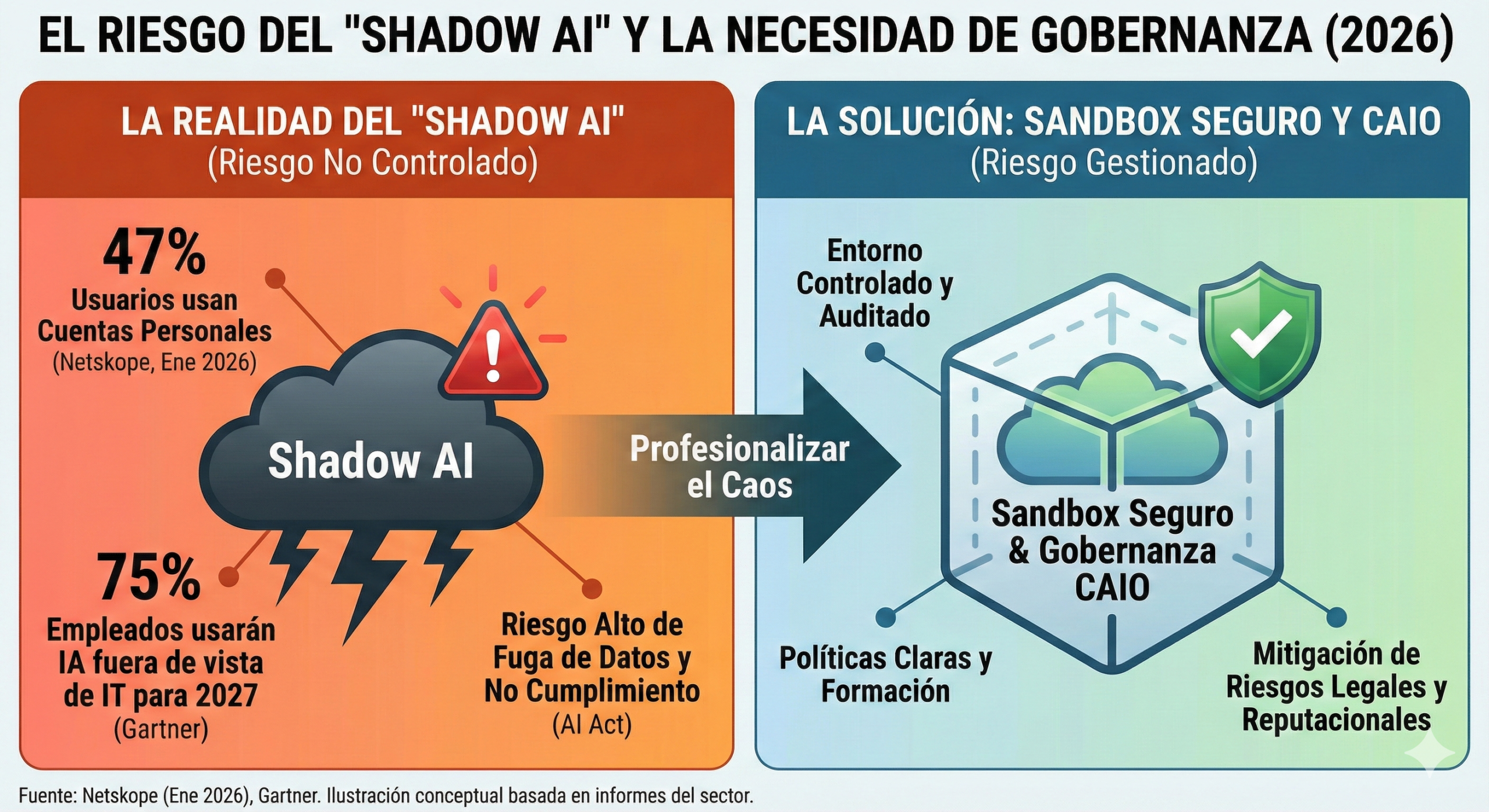

Mientras debatís en el consejo si aprobar o no el uso de Copilot, vuestra plantilla ya lo está usando a vuestras espaldas. Y lo hacen desde cuentas gratuitas, sin seguridad y sin contrato de confidencialidad.

El Enemigo en Casa: ¿Qué es el Shadow AI?

El «Shadow AI» ocurre cuando los empleados utilizan herramientas de Inteligencia Artificial no autorizadas por el departamento de IT para realizar su trabajo. Lo hacen por productividad, pero el coste legal puede ser la quiebra reputacional.

Según informes de ciberseguridad de 2026 (Netskope/Cisco), más del 50% de los empleados admiten haber compartido datos corporativos con IAs generativas sin permiso.

⚠️ El Dato del Miedo: Si un empleado sube un contrato confidencial a ChatGPT (versión gratuita), OpenAI puede usar legalmente ese contrato para entrenar a su modelo. Vuestro secreto industrial podría ser la respuesta que le dé el chat a vuestra competencia mañana.

Prohibir NO funciona (La Ley Seca Digital)

Muchas empresas reaccionan con el «Bloqueo Total»: cerrar el acceso a ChatGPT en la red de la oficina. Es un error de principiante.

Si bloqueáis la herramienta, el empleado simplemente usará su móvil personal con 4G. Ahora tenéis el mismo riesgo, pero cero visibilidad.

La Solución: Gobernar, no Prohibir

Para mitigar el riesgo legal, necesitáis crear un «Sandbox Seguro» (Entorno de Pruebas) y, sobre todo, una política de uso clara.

- No digáis: «Prohibido usar IA».

- Decid: «Esta es la IA corporativa (Enterprise) que debéis usar, y estos son los datos que NUNCA debéis subir».

¿Quién va a la cárcel si la IA alucina?

Si un algoritmo de selección de personal discrimina a mujeres, o si un chatbot promete un descuento erróneo a un cliente, ¿de quién es la culpa?

Bajo la nueva normativa europea (AI Act), la responsabilidad final recae sobre el Consejo de Administración por «falta de supervisión». No podéis culpar al becario ni al software.

Necesitáis un Sheriff en el pueblo: El CAIO

El departamento legal sabe de leyes, pero no de algoritmos. El departamento de IT sabe de código, pero no de leyes.

El Chief AI Officer (CAIO) es el único perfil capaz de traducir los riesgos técnicos a lenguaje legal. Su función no es solo acelerar la IA, sino ponerle frenos de emergencia (Compliance).

🔗 Profundiza en el rol: Para entender cómo esta figura protege legalmente a la empresa, leed nuestro análisis técnico sobre Liderazgo y Estrategia de IA.

La Hoja de Ruta para el Compliance

Si queréis evitar ser el próximo titular de un escándalo de privacidad, los expertos recomendamos dos líneas de actuación inmediata:

1. Crear un «Firewall Humano» (Cultura)

La tecnología no detiene las filtraciones; la cultura sí. Es imperativo establecer programas de concienciación sobre Privacidad y Prompt Hacking. El empleado debe entender que «copiar y pegar» datos sensibles en una IA pública es tan grave como dejar la puerta de la oficina abierta de noche.

2. Auditoría de Algoritmos (Gobernanza)

No lancéis ningún modelo al mercado sin una auditoría de sesgos y alucinaciones. Establecer marcos de trabajo éticos no es solo «buenismo», es protección financiera ante posibles demandas.

La seguridad en la era de la IA no se compra con software, se construye con estrategia.

⚖️ Preguntas Frecuentes Legales (Lo que preocupa a Compliance)

➕ ¿Es legal que mis empleados usen ChatGPT gratuito en el trabajo?

No es ilegal per se, pero es una negligencia grave de seguridad. Los términos de uso de la versión gratuita permiten a OpenAI usar vuestros datos para entrenamiento. Debéis migrar urgentemente a licencias Enterprise o API privadas.

➕ ¿Quién es responsable si nuestra IA da un consejo financiero erróneo?

La empresa. La IA no tiene personalidad jurídica. Si vuestro chatbot comete un error (alucinación) que causa perjuicio a un cliente, la responsabilidad civil y reputacional es 100% de la compañía. Necesitáis supervisión humana obligatoria (Human-in-the-loop).

➕ ¿Cómo evito el «Shadow AI» sin bloquear internet?

Con formación y alternativas. El empleado usa Shadow AI porque la herramienta oficial es mala o inexistente. Ofreced un entorno seguro (Sandbox) y formadles en los riesgos. La prohibición técnica siempre fracasa frente a la necesidad operativa.